"Non ci può più essere alcun dubbio che i presupposti dell'economia delle organizzazioni, cioè le assunzioni di una razionalità perfetta, sono contrarie ai fatti. Non è un problema di maggiore o minore approssimazione; questi presupposti non descrivono neanche lontanamente i processi che gli esseri umani adottano per prendere delle decisioni in situazioni complesse". Herbert Simon (1916, 2001), Rational Decision Making in business organizations.

Secondo Simon la teoria economica neoclassica richiede che ogni agente economico sia sempre in grado di:

1) specificare l'esatta natura dei risultati;

2) specificare in modo coerente se un risultato è migliore uguale o peggiore di ogni altro;

3) associare probabilità definite ai risultati. ...

Non c'è nessuna evidenza che, nelle reali situazioni di scelta umane di una qualche complessità, questi calcoli possano essere o siano in effetti eseguiti". Causalità, razionalità, organizzazione.

"... appare ovvio che la teoria dell'utilità ... non sia mai stata applicata, né mai possa esserlo, al mondo reale; dato che ho avuto più volte occasione di usare la teoria dell'utilità ... nel corso delle mie ricerche mi sia concesso di scagliare la prima pietra, e contro le mie stesse finestre!". La ragione nelle vicende umane.

"... il tutto è maggiore della somma delle parti, non in senso ultimo, metafisico, ma nell'importante senso pragmatico che, date le proprietà delle parti e le leggi della loro interazione, non è semplice dedurre le proprietà del tutto" L'architettura della complessità

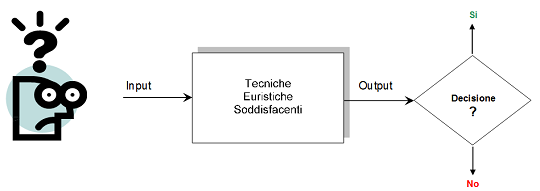

Molti sono i concetti toccati da Herbert Simon nel corso dei suoi studi e lavori che dovrebbero essere riportati in questa scheda: i processi decisionali, la razionalità limitata, le strategie soddisfacenti, le funzioni di utilità, le tecniche euristiche, l'alternativa normativo/descrittivo, l'intelligenza artificiale, la teoria dei sistemi, quella della complessità e ovviamente il problem solving.

Simon ben presto aveva abbandonato l'impostazione normativa e razionale dell'economia neo-classica (teoria dello "Homo oeconomicus"), della teoria dei giochi, del controllo automatico e dei filoni "Hard" della ricerca operativa (scelte ottimizzanti). Egli aveva introdotto la dimensione psicologica nello studio delle scelte, attraverso l'analisi del comportamento decisionale che l'agente normalmente attua, condizionato com'è tanto dai propri limiti, per esempio di memoria o capacità di usare dati o conoscenze di cui dispone, quanto dalla complessità dell'ambiente in cui si trova ad operare. Ecco alcuni esempi dei limiti individuati da Simon:

1) limiti attenzionali: non riusciamo a seguire nel contempo più eventi;

2) limiti della memoria di lavoro: non possiamo riflettere consapevolmente che su un numero limitato di informazioni;

3) limiti della memoria a lungo termine: è faticoso registrare i risultati dei nostri ragionamenti;

4) limiti nella coerenza delle conoscenze: è impossibile confrontare tutte le nostre credenze in modo da poterle rendere coerenti.

L'insieme di questi vincoli fa si che spesso sia naturale, opportuno e più rapido accontentarsi di prestazioni cognitive soddisfacenti. Merito di Simon quindi è aver riflettuto sul fatto che nel risolvere i problemi la mente umana difficilmente riesce a considerare più di 6 o 7 variabili alla volta; pertanto è illusorio pensare che modelli matematici basati sul feed-back e sul controllo, sull'utilità attesa, sulle teorie dell'equilibrio economico o sulla ottimizzazione possano da soli risolvere tutti i problemi delle organizzazioni.

Queste intuizioni di Simon hanno avuto conferma dai più recenti risultati ottenuti dalla psicologia cognitiva, dall'economia comportamentale e dagli studi sul cervello effettuati dalle neuroscienze con la risonanza magnetica funzionale. In particolare si è trovato che per il nostro cervello:

1) le decisioni diventano problematiche se si hanno troppe informazioni,

2) è difficile considerare più di 7 item alla volta,

3) se le informazioni sono troppe prendiamo decisioni peggiori e comunque insoddisfacenti,

4) la vigilanza e l'attenzione calano con il numero di elementi da considerare,

5) le prestazioni peggiorano se le informazioni ci arrivano ravvicinate nel tempo,

6) pesano maggiormente le ultime informazioni arrivate,

7) è difficile individuare criteri con peso medio o basso: o tutto o niente,

8) è più facile essere creativi se rilassati (ad esempio sotto la doccia),

9) alcune delle decisioni migliori sono emotive o inconsce,

10) è meglio essere soddisfatti di poche informazioni (sufficers) che ricercarle tutte sistematicamente (maximaizers).

Nel 1956 il matematico John Mc Carty assieme a Shannon, Minsky e altri aveva organizzato un incontro al Dartmouth college (Hanover, New Hampshire), poi considerato fondativo dell'intelligenza artificiale (IA), incentrato sull'ipotesi che "ogni aspetto dell'apprendimento o ogni altra caratteristica dell'intelligenza possono essere, in linea di principio, descritti in modo così preciso da poter essere simulati da una macchina". Nel 1947 Simon aveva scritto "Il comportamento amministrativo" (Il Mulino, Bologna 1979), nel quale si era posto domande che lo avrebbero poi portato a unirsi al gruppo dei fondatori dell'intelligenza artificiale: come fanno i dirigenti d'azienda a prendere una decisione? Quale è il procedimento mentale che li porta, nella confusione e nella parzialità dei dati di cui dispongono, a decidere come comportarsi per far sopravvivere la propria impresa? In generale come fanno gli umani a risolvere i problemi?

Un problema (come in molti giochi e quindi anche negli scacchi) può essere rappresentato da un albero i cui rami, grazie alla combinazione delle molteplici scelte possibili, crescono in modo esponenziale sino ad arrivare alle foglie che, nella metafora, rappresentano tutte le possibili soluzioni. Simon assieme al fisico Allen Newell e al programmatore Clifford Shaw aveva ipotizzato un programma per gli scacchi che non fosse basato in modo cruciale sui perfezionamenti della funzione di valutazione di Shannon, ma piuttosto sull'implementazione di quelle strategie soddisfacenti che egli aveva considerato il cuore dei processi umani di soluzione dei problemi. Newell (1927,1992) aveva seguito i corsi del matematico George Polya, il quale, nel suo "How to Solve it" del 1945, aveva definito i processi della soluzione di problemi come "euristici", cioè basati sull'uso di indizi ed espedienti utili alla ricerca della soluzione: un'idea che richiamava molto da vicino quella della strategia soddisfacente di Simon.

Assieme a Newell e Shaw, Simon ideò diversi programmi di intelligenza artificiale tra cui Logic Theorist (LT), che dimostrava alcune proposizioni dei Principia Mathematica di Russell, General Problem Solver (GPS), che simulava i processi mentali di una persona che tenta di risolvere un generico problema logico matematico e Bacon1, che riscopriva le leggi di Keplero. Oggi però Simon non è tanto ricordato per i suoi programmi di IA: neanche il programma di scacchi Deep Blue, che ha battuto Kasparov, è molto basato sull'uso di regole euristiche, ma piuttosto sulla forza bruta dei nuovi computer in grado di valutare, meglio di un umano, i molti sviluppi o rami del gioco. Forse si può azzardare l'ipotesi che il contributo maggiore di Simon alla analisi dei processi e dei problemi delle organizzazioni venga dalla considerazione che questi sono spesso troppo complessi per essere affrontati solo con la razionalità e l'ottimizzazione: il buon senso, l'euristica, l'intuizione, l'emotività e l'esperienza giocano anch'essi un ruolo determinante. (Yurij Castelfranchi, Oliviero Stock, "Macchine come noi: la scommessa dell'intelligenza artificiale", Laterza 2000).

![Processi decisionali multiattore e multiobiettivo [Bernard Roy]](https://cdn.skuola.net/shared/thumb/159x141/news_foto/images/stories/problem_solving/bernard-roy.png)