Sto studiando il metodo delle differenze finite. Il testo di riferimento fa un breve richiamo al teorema di Taylor:

Dalla formula di Taylor con resto di Lagrange: $f(x)=\sum_{k=0}^\infty f^k(x)/(k!)(x-x_0)^k+O(x-x_0)^(k+1)\star$.

Vista così, non mi torna il modo in cui viene stimato l'errore.

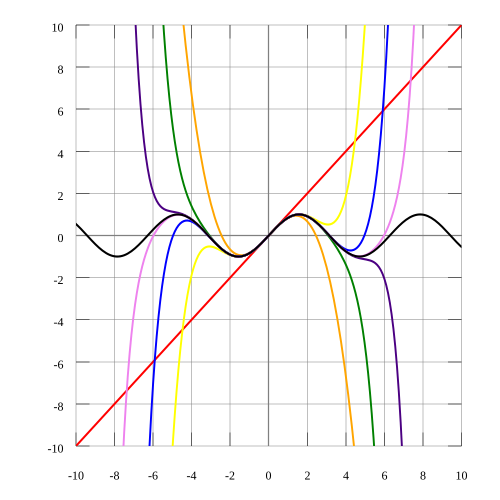

Si consideri a titolo d'esempio lo sviluppo di McLaurin di $sin(x)$ (quanto segue vale per una qualsiasi funzione analitica):

È chiaro come l'intervallo in cui il polinomio di McLaurin converge alla funzione reale cresca al crescere dell'ordine. Il polinomio del settimo ordine (curva verde) bene approssima la funzione tra $-pi$ e $+pi$. Evidentemente l'errore commesso valutando la funzione in $pi$ con il polinomio del 7 ordine è inferiore a quello commesso valutandola con il polinomio del quinto ordine (curva gialla). Eppure, dalla $\star$, il primo risulta essere di due ordini di grandezza superiore al secondo. Insomma, per $x-x_0<1$ i conti tornano e in effetti all'aumentare dell'ordine decresce l'errore, ma per $x-x_0>1$ vale il contrario. È come se la $\star$ valesse soltanto per $x-x_0<1$.

Dove sbaglio?