La media campionaria come variabile aleatoria "sta dietro al costrutto teorico" secondo il quale si arriva a dire che quella variabile aleatoria è lo stimatore ottimo in un determinato senso.

La media osservata serve per avere la stima del parametro, ovviamente.

21 messaggi

• Vai alla pagina... • 1, 2, 3

Re: Statistica campionaria e media campionaria

@tommik:

tommik ha scritto:CLaudio Nine ha scritto:b) A cosa servono le funzioni "statistiche campionarie"? Ho provato a leggere dai miei libri di testo ma devo ammettere che mi appare tutto oscuro.

te lo spiego io...

...

1) Definiamo un modello statistico adeguato.

...

Devo però capire quanto vale il parametro $theta$

2) Si fa quindi un esperimento che consiste nell'estrarre un certo numero di palline

...

3) Stimo quindi il parametro ignoto $theta$ utilizzando la statistica campionaria $bar(X)_10$ ottenendo una stima del parametro ignoto

...

Okay quindi la statistica campionaria è semplicemente una funzione che mi permette di dedurre i parametri di interesse relativi al modello statistico che presumo governi il fenomeno di interesse!

In questo caso ho presunto (ovviamente) un modello statistico bernoulliano.

Il parametro di interesse che non conosco e che voglio stimare grazie all'uso della funzione "statistica campionaria" è $theta$.

In questo caso $theta$ sarà uguale alla probabilità di estrarre una pallina bianca, e, di conseguenza, quante palline bianche ci sono (ovviamente non ragiono in termini di fatti certi ma di stime).

Sei d'accordo tommik?

Sergio ti rispondo subito.

- CLaudio Nine

- Average Member

- Messaggio: 240 di 721

- Iscritto il: 27/09/2018, 20:13

Re: Statistica campionaria e media campionaria

Non posto risposte ma sappiate che sto seguendo il post con moltissimo interesse mentre studio dai libri.

CLaudio Nine condivido molti dei tuoi dubbi.

CLaudio Nine condivido molti dei tuoi dubbi.

- anonymous_58f0ac

- Average Member

- Messaggio: 124 di 648

- Iscritto il: 30/11/2019, 13:37

Re: Statistica campionaria e media campionaria

@Sergio

Sergio ha scritto:CLaudio Nine ha scritto:a) Sbaglio nel dire che fino al punto 2 sembra lo studio di una binomiale?

Non senti la mancanza del coefficiente binomiale?

Caspita è vero!!

Sergio ha scritto:

Definisco invece la media e la statistica campionarie, che sono variabili aleatorie con una loro distribuzione.

Domanda1:

la media campionaria la definisco a priori?

Non faccio altro che definire una variabile aleatoria chiamata media campionaria e a fare un'ipotesi su quella che sarà la sua distribuzione?

Successivamente calcolerò poi quanto sarà probabile che la media campionaria sia lontana dal valor medio?

Domanda2:

prendendo una frase da te scritta, provo a estenderla. Dimmi pure se dico qualche cavolata:

Assumo che il fenomeno segua una qualche distribuzione di probabilità, su questa base e senza guardare i dati definisco statistiche campionarie intese come variabili aleatorie.

Tale funzioni sono utili se non necessarie per definire i parametri di interesse ($theta$ per bernoulliane e binomiali, $lambda$ per esponenziali, $mu$ e $sigma$ per normali, ecc.)

- CLaudio Nine

- Average Member

- Messaggio: 241 di 721

- Iscritto il: 27/09/2018, 20:13

Re: Statistica campionaria e media campionaria

anonymous_58f0ac ha scritto:Non posto risposte ma sappiate che sto seguendo il post con moltissimo interesse mentre studio dai libri.

CLaudio Nine condivido molti dei tuoi dubbi.

Mi fa piacere! Sinceramente avevo sottovalutato questa materia, sono molto pochi i concetti che sono "scontati".

- CLaudio Nine

- Average Member

- Messaggio: 242 di 721

- Iscritto il: 27/09/2018, 20:13

Re: Statistica campionaria e media campionaria

Sergio ha scritto:Sintetizzare un corso di inferenza in poche righe non è semplice. Provo a isolarne il "nocciolo".

Si assume che i dati siano realizzazioni di variabili aleatorie di cui ignoro i parametri. Mi muovo su un piano solo teorico (non mi baso sui dati) per ottenere, passando attraverso una serie di altre variabili aleatorie (statistiche campionarie, ma anche altre), variabili aleatorie che sono trasformazioni delle statistiche campionarie ma di cui conosco i parametri (come la $t$ dell'esempio).

A questo punto, uso le realizzazioni osservate delle statistiche campionarie (ad es. la media osservata) per ottenere realizzazioni di quelle variabili aleatorie di cui conosco i parametri.

In questo modo posso finalmente giungere a conclusioni, ad esempio posso dire quanto è "significativa" una certa differenza tra due temperature medie, ovvero quanto è "credibile" che la differenza sia dovuta solo al caso oppure all'efficacia di un nuovo farmaco.

Non è semplice (c'è tanta teoria da studiare) e, come se non bastasse, quello appena descritto non è l'unico approccio possibile.

Sergio grazie mille, i tuoi commenti e anche quelli di tommik sono molto apprezzati.

Non ti ho risposto prima perché da qualche giorno mi sono ritirato da Internet e da qualsiasi mezzo di comunicazione. Mi sono messo a capo chino sui libri come un monaco a studiare Statistica e Fisica Tecnica.

Come ha giustamente detto CLaudio Nine, la materia è molto più complicata del previsto.

- anonymous_58f0ac

- Average Member

- Messaggio: 125 di 648

- Iscritto il: 30/11/2019, 13:37

Re: Statistica campionaria e media campionaria

Pensavo di aver terminato con l'inferenza....è invece è saltata fuori l'inferenza bayesiana.

Sergio ma questi 4 punti riguardano l'inferenza statistica classica giusto?

In quale punto l'inferenza bayesiana è differente?

Sergio ha scritto:1) assumi che il fenomeno d'interesse abbia una certa distribuzione di probabilità; ad esempio, nel lancio di una moneta assumi che si tratti di una distribuzione bernoulliana; formalmente, definisci il modello probabilistico $\{\chi, f_X(x;\theta), \Theta\}$ dove, nel caso di una bernoulliana:

-- $\chi$ è insieme dei valori che la v.a. può assumere, $\chi=\{0,1\}$;

-- $f_X(x;\theta)$ è la distribuzione di probabilità della variabile aleatoria, $\theta^x(1-\theta)^{1-x}$ (con $x in \chi$);

-- $\Theta$ è lo spazio dei parametri, l'insieme dei valori che il parametro può assumere, $\Theta=[0,1]$;

2) definisci il campione casuale come una $n$-upla di variabili aleatorie indipendenti e identicamente distribuite; ad esempio prendi i lanci di $n$ monete o $n$ lanci della stessa moneta e supponi di avere a che fare con $n$ variabili aleatorie bernoulliane; ottieni così il modello statistico che nel caso di $n$ lanci di una moneta è $\{\chi^n; f_n(x_n;\theta)=\prod_{i=1}^n f_X(x_i;\theta); \Theta\}$ dove:

-- $\chi^n=\{0,1\}\times\{0,1\}\times ... \times\{0,1\}=\{0,1\}^n$;

-- $f_n(x_n;\theta)=\prod_{i=1}^n f_X(x_i;\theta)=\prod_{i=1}^n \theta^x(1-\theta)^{1-x}=\theta^{\sum_i x_i}(1-\theta)^{n-\sum_i x_i}$;

-- $\Theta$ è ancora $[0,1]$;

3) definisci statistiche campionarie, che sono funzioni \(\chi^n \to \mathcal{T}\), con \(\mathcal{T}\subset\mathbb{R}^k, k\ge 1\); tra esse la media campionaria. Nel fare questo ragioni solo sulle $n$ variabili aleatorie;

4) guardi i valori osservati e cerchi di capire fino a che punto questi "si avvicinano" a quelli teorici, ad esempio quanto 4 teste in 10 lanci è coerente con la media campionaria se $\theta=0.5$ (moneta regolare).

Sergio ma questi 4 punti riguardano l'inferenza statistica classica giusto?

In quale punto l'inferenza bayesiana è differente?

- anonymous_58f0ac

- Average Member

- Messaggio: 126 di 648

- Iscritto il: 30/11/2019, 13:37

Re: Statistica campionaria e media campionaria

Differente in tutto (io sono un bayesiano di formazione)

Qui, in evidenza nella prima pagina della stanza, trovi un mio riassunto sulla prova di ipotesi bayesiana con molti esempi che ho raccolto ed in parte rielaborato in diversi anni. Tali esempi possono essere ovviamente utilizzati anche per risolvere problemi di stima, sia puntuale che per intervallo.

Ne dovrei fare uno anche sulla stima ma sono argomenti che non interessano....ci dovrebbe essere anche qualche topic in proposito.

fammi sapere se sei interessato al problema

Qui, in evidenza nella prima pagina della stanza, trovi un mio riassunto sulla prova di ipotesi bayesiana con molti esempi che ho raccolto ed in parte rielaborato in diversi anni. Tali esempi possono essere ovviamente utilizzati anche per risolvere problemi di stima, sia puntuale che per intervallo.

Ne dovrei fare uno anche sulla stima ma sono argomenti che non interessano....ci dovrebbe essere anche qualche topic in proposito.

fammi sapere se sei interessato al problema

- tommik

- Moderatore

- Messaggio: 5352 di 11278

- Iscritto il: 23/04/2015, 13:13

- Località: Cassano Magnago

Re: Statistica campionaria e media campionaria

tommik ha scritto:Differente in tutto (io sono un bayesiano di formazione)

Qui, in evidenza nella prima pagina della stanza, trovi un mio riassunto sulla prova di ipotesi bayesiana

Ne dovrei fare uno anche sulla stima ma sono argomenti che non interessano....ci dovrebbe essere anche qualche topic in proposito.

fammi sapere se sei interessato al problema

In tutto??? Mi era parso di capire che almeno il punto $1)$ fosse uguale!

P.s. Grazie mille per il riassunto tommik, lo divoro (sperando che non sia lui a divorare me).

- anonymous_58f0ac

- Average Member

- Messaggio: 127 di 648

- Iscritto il: 30/11/2019, 13:37

Re: Statistica campionaria e media campionaria

anonymous_58f0ac ha scritto:

In tutto??? Mi era parso di capire che almeno il punto $1)$ fosse uguale!

Non è questione di "passaggi", anzi sotto alcune condizioni il risultato può essere lo stesso. E' proprio diversa la logica sottostante

qui un esercizio propedeutico che ho inventato proprio per far entrare l'utente nella logica bayesiana

qui un topic

qui una prima dispensina (davvero base, non esaustiva) che rende bene l'idea su come procedere

Prima di leggere il mio tutorial devi necessariamente avere un minimo (anche un po' più di un minimo) di basi. La logica bayesiana è completamente diversa da quella classica.

Se sei interessato sto preparando un bel topic sulle "osservazioni critiche" alle tecniche di Statistica Classica in contrapposizione a quella Bayesiana....ma per metterlo nero su bianco...anzi, nero su forum mi ci vuole del tempo...

Per iniziare a capire la differenza di logica fra Classico e Bayesiano dovresti almeno leggere anche l'altro tutorial, sulla ricerca dello stimatore ottimo in senso Classico...

qui un primo esempio sulla coerenza delle stime.

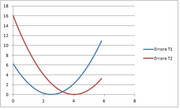

Vediamone un altro

Sia $X~N(theta;1)$. Il problema è quello di fare inferenza in modo Classico sul parametro ignoto $theta$, cioè sulla media della popolazione

Estraiamo un campione casuale $(X_1,X_2)$ e proponiamo i seguenti stimatori

$T_1=(X_1+X_2)/2$

$T_2=X_1$

Nella statistica classica la scelta tra due stimatori avviene generalmente confrontando l'Errore Quadratico Medio (EQM).

Vediamo subito che i due stimatori sono non distorti, essendo

$mathbb{E}[T_1]=1/2(theta+theta)=theta$

$mathbb{E}[T_2]=theta$

...e quindi per "misurare" la bontà dei due stimatori confrontiamo le loro varianze

$mathbb{V}[T_1]=1/4(1+1)=1/2$, $AA theta$

$mathbb{V}[T_2]=1$, $AA theta$

Quindi, ragionando in modo classico, $T_1$ è sempre preferito a $T_2$. Inoltre, per ragioni note e spiegate nei link precedenti, $T_1$ è lo stimatore ottimo in senso classico (la sua varianza raggiunge addirittura il limite inferiore di Cramér Rao)

Conclusione: scegliamo SEMPRE $T_1$ rispetto a $T_2$ (ed anche rispetto a qualunque altro stimatore non distorto) INDIPENDENTEMENTE da qualunque altra informazione in nostro possesso (è una scelta oggettiva).

Supponiamo ora di effettuare un esperimento e di aver ottenuto i seguenti dati

$x_1=4$

$x_2=1$

A questo punto le due stime saranno

$hat(T)_1=5/2$

$hat(T)_2=4$

Consideriamo ora l'errore quadratico (in funzione di $theta$) che si commette dopo aver osservato il dato sperimentale

1) $(theta-5/2)^2$

2) $(theta-4)^2$

Se disegnamo il grafico di tali errori, in funzione di $theta$

osserviamo che, a dispetto di tutta la teoria classica, se $theta>13/4$ (intersezione fra le due parabole) lo stimatore $T_2$ è preferito allo stimatore $T_1$.

Il fatto è dovuto che nella Statistica Classica si confronta la media degli errori indipendentemente da altre informazioni in nostro possesso

...vale quindi la pena di pensare ad un ragionamento induttivo coerente: ovvero usare il teorema di Bayes con tutto ciò che ne consegue.

- tommik

- Moderatore

- Messaggio: 5353 di 11278

- Iscritto il: 23/04/2015, 13:13

- Località: Cassano Magnago

21 messaggi

• Vai alla pagina... • 1, 2, 3

Torna a Statistica e probabilità

Chi c’è in linea

Visitano il forum: Nessuno e 1 ospite